Pearsonov koeficient korelacije

Pearsonov koeficient korelacije (rxy, ρxy) je matematična in statistična številska mera, ki predstavlja velikost linearne povezanosti spremenljivk in , merjenih na istem predmetu preučevanja. Koeficient je definiran kot vsota vseh produktov standardnih odklonov obeh vrednosti v razmerju s prostostnimi stopnjami, oziroma kot razmerje med kovarianco in produktom obeh standardnih odklonov:

kjer je:

- – z-vrednost spremenljivke ,

- – z-vrednost spremenljivke ,

- – število vseh statističnih enot.

ali:

kjer je:

- – kovarianca,

- – standardni odklon spremenljivke ,

- – standardni odklon spremenljivke .

Dobljeni rezultat je eden izmed kvadratnih korenov (bodisi pozitiven bodisi negativen) koeficienta determinacije , ki je razmerje med pojasnjeno varianco in skupno varianco:

kjer je:

- – dejanska vrednost dane spremenljivke ,

- – predvidena vrednost iste spremenljivke ob znani korelaciji med in ter vrednosti .

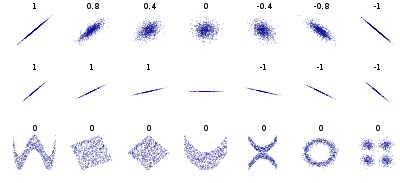

Pogoj za računanje tega koeficienta je linearna odvisnost obeh vpletenih spremenljivk. Za določanje povezanosti spremenljivk, ki niso povezane linearno, se uporablja Spearmanov koeficient korelacije.

Vrednost[uredi | uredi kodo]

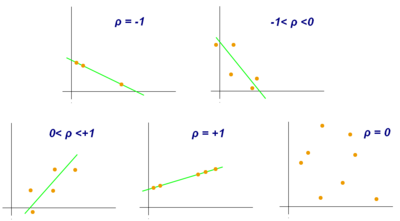

Vrednost Pearsonovega koeficienta korelacije se lahko nahaja med vrednostima -1 in 1. Tako vrednost -1 predstavlja popolno negativno povezanost spremenljivk, pri čemer je na grafu odvisnosti videti le ravno črto, ki z naraščajočo neodvisno spremenljivko potuje navzdol; obratno vrednost 1 pomeni popolno pozitivno povezanost in navzgor usmerjeno črto na grafu. V praktičnem preizkušanju odvisnosti in uporabni statistiki je skoraj nemogoče izračunati popolno (funkcijsko) odvisnost -1 ali 1, saj na posamezno odvisno spremenljivko vpliva praviloma več dejavnikov, med njimi tudi slučajni vplivi. Pearsonov koeficient 0 označuje ničelni vpliv ene spremenljivke na drugo.

Izračunano povezanost se lahko opiše tudi tako [1]:

- 0,00 – ni povezanosti

- 0,01-0,19 – neznatna povezanost

- 0,20-0,39 – nizka/šibka povezanost

- 0,40-0,69 – srednja/zmerna povezanost

- 0,70-0,89 – visoka/močna povezanost

- 0,90-0,99 – zelo visoka/zelo močna povezanost

- 1,00 – popolna (funkcijska) povezanost

Enačbo, ki najbolje opisuje linearno odvisnost obeh spremenljivk, je moč izračunati z linearno regresijo. Ta enačba je ob visokih vrednostih Pearsonovega koeficienta (bližina -1 oziroma +1) najbolj točna.

Pearsonov koeficient korelacije je imenovan po britanskem statistiku Karlu Pearsonu, navzlic temu pa ga je prvi uporabljal Anglež Francis Galton.

Sklici[uredi | uredi kodo]

- ↑ Pearsonov koeficient korelacije, http://www.benstat.si/blog/pearsonov-koeficient-korelacije