Linearna regresija

| Ta članek potrebuje čiščenje. Pri urejanju upoštevaj pravila slogovnega priročnika. |

Regresija meri odvisnost dveh slučajnih spremenljivk - kakšen vpliv ima ena na drugo.

Na populaciji merimo 2 podatka, zanima nas vrsta odvisnosti med slučajnima spremenljivkama.

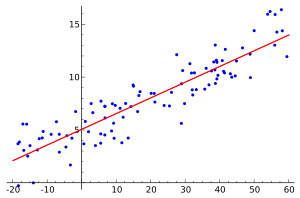

Razsevni grafikoni

1. in 2. : linearna regresija

Iščemo krivuljo ki bi se podatkom najboljše prilegala. Če je linearna regresija iščemo premico.

y = k*x+n

Glede na to kako bi krivulja »morala izgledati« začnemo graditi krivuljo ki se bo najbolje prilegala.

Zgledi[uredi | uredi kodo]

- Dnevna količina padavin in število gledalcev na nogometni tekmi.

- Starost in cena avtomobila.

- Število pokajenih cigaret in življenjska doba.

Linearna regresija[uredi | uredi kodo]

- 1. regresijska premica

Parametra a in b izberemo po metodi najmanjših kvadratov tako, da minimiziramo (pogledamo za vsako meritev koliko daleč navpično (y) leži od premice, vsota kvadratov vseh meritev mora biti čimmanjša).

- 2. regresijska premica

Drugo regresijsko premico dobimo tako, da minimiziramo vsoto kvadratov odstopanj v x smeri.

Regresijski premici tipično nista enaki.

- Definicija

- Trditev

- 1. in 2. regresijska premica se sekata v točki (E(X),E(Y))